Le retour anticipé du Llama

Meta s'apprête à lancer les premières versions de Llama 3, attendu cet été • Google déploie Gemini 1.5 Pro • Le patron de ARM lance une alerte sur la consommation électrique de l'IA • Monad Labs veut créer un nouvel Ethereum • Bienvenue dans Qant, jeudi 11 avril 2024.

« Le progrès est devant nous, à condition de dépasser sa propagande » Paul Virilio

Chaque jour, les journalistes de Qant illustrent les tendances de fond qui animent la tech. Ils s’appuient sur Kessel Média et utilisent l’IA générative depuis mars 2022.

L’ÉVÉNEMENT

Quand Llama3 fâché, Señor, lui toujours faire ainsi…

Alors que le grand modèle de Meta ne devrait être disponible que dans quelques mois, les versions plus légères pourraient être présentées d’un jour à l’autre. Et les grandes caractéristiques du modèle sont déjà connues. Dont un “wokisme” réduit après le scandale Gemini.

Meta Platforms se prépare à lancer deux versions réduites de son prochain modèle de langage open source, Llama 3. Le modèle complet est attendu en juillet prochain. Il devrait compter plus de 140 milliards de paramètres (contre 70 milliards pour Llama 2), ce qui en fera le plus grand modèle open source. Mais, d’après The Information, les jours qui viennent devraient voir apparaître des versions plus petites du modèle, donc moins coûteuses et plus rapides à exécuter. Après le scandale qui a conduit Google à suspendre la génération d’images sur Gemini (lire Qant du 23 février), Llama 3 a été rendu plus ouvert aux controverses que Llama 2, jugé trop prudent dans ses réponses.

On ignore encore son comportement s’il se fâche.

L’INTÉGRALITÉ DE CET ARTICLE EST DISPONIBLE EN FIN DE LETTRE

L’ESSENTIEL : ARM, Google, Meta, Microsoft, Monad Labs, Rainbow Robotics

INTELLIGENCE ARTIFICIELLE

Gemini partout

À l’occasion de sa convention annuelle, Google Cloud a présenté une batterie de nouveaux outils et fonctionnalités IA, dont le modèle Gemini 1.5 Pro.

L'événement Google Cloud Next 2024, en début de semaine à Las Vegas, a été l'occasion pour le groupe de présenter une foule de nouveaux services d’IA. Même dans son cœur de métier, la principale annonce de Google Cloud concerne l’IA : la plateforme Blackwell de Nvidia sera disponible sur Google Cloud début 2025, avec des serveurs GB200 pour l'entraînement de LLM toujours plus puissants.

Le modèle a des oreilles

En matière de LLM, Google continue d’exciter la curiosité sur Gemini 1.5 Pro, décrit comme le “modèle d'IA générative le plus capable” de Google. Il est désormais proposé en “prévisualisation” sur Vertex AI. Sa fenêtre d’attention peut comprendre jusqu'à 1 million de tokens, contre quelques dizaines de milliers pour ses rivaux (lire Qant du 16 février). On peut donc lui proposer, en guise de prompt, une heure de vidéo ou onze heures de fichiers audio, aussi bien que des images et du texte. Gemini Code Assist, nouveau nom de son assistant de code Codey, bénéficie déjà de cette fenêtre contextuelle d'un million de tokens.

La suite bureautique Google Workspace intègre Google Vids, une IA de création vidéo qui permet aux utilisateurs de réaliser des vidéos à partir du traitement de texte Docs et et du tableur Sheets, afin de faciliter la collaboration. De nombreuses autres mises à jour incluent des alertes personnalisables sur Sheets et la prise en charge des onglets dans Docs.

Monétisation

Google a aussi révélé des plans pour monétiser de nouvelles fonctionnalités d'IA pour Google Workspace, proposant des suppléments (“add-on packages”) à 10 dollars par mois et par utilisateur – un tiers du prix de son concurrent chez Microsoft, Copilot. Ces fonctionnalités comprennent une aide IA aux réunions et à la messagerie, ainsi qu'un package de sécurité IA.

Par ailleurs, Google a annoncé la disponibilité générale d’Imagen 2, son outil de génération d'images intégré à Gemini annoncé en décembre dernier (lire Qant du 22 décembre 2023). Depuis, la génération d’images par Google a fait débat : fin février, des hallucinations de Gemini générant des portraits anormaux au nom de la diversité avaient entraîné une suspension temporaire de la série de modèles (lire Qant du 23 février).

Pour en savoir plus :

IA et droit d’auteur, un problème général • Alors qu’en Europe l’AI Act contraindra l’an prochain les créateurs d’IA à la transparence sur les données d’entraînement, la polémique gagne les États-Unis. Un projet de loi présenté au Congrès américain vise à obliger les entreprises d'intelligence artificielle à révéler les œuvres protégées par des droits d'auteur utilisées pour entraîner leurs modèles. Présenté par un élu démocrate dans une chambre républicaine lors d’une année électorale, le projet n’a guère de chances d’aboutir. Toutefois, de nombreuses entreprises de contenu et association d’ayants droit le soutiennent comme le syndicat Sag-Aftra ou encore la Recording Industry Association of America. Un signe de plus de la fragilité d’OpenAI, qui n’a toujours pas justifié des données d’entraînement de GPT-4. Le procès du New York Times prend une ampleur politique (lire OpenAI, colosse aux pieds d’argile et Qant du 8 janvier).

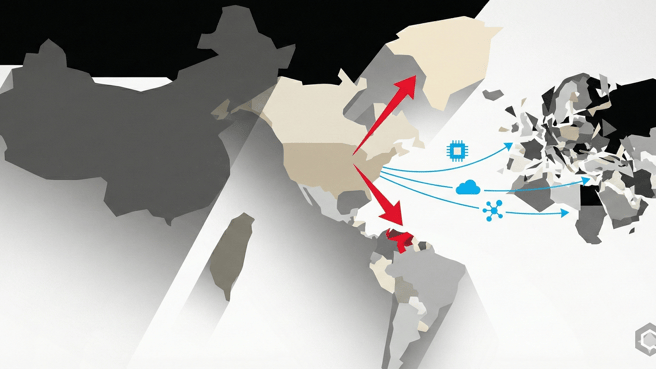

Pour en savoir plus: The GuardianLe cri d’alARM de Rene Haas • La consommation électrique croissante des centres de données IA pourrait représenter 20 à 25% de la consommation électrique des États-Unis d’ici 2030 selon René Haas, CEO du leader des microprocesseurs pour téléphonie mobile ARM, dans une interview au Wall Street Journal. Les modèles de langage nécessitent beaucoup plus d'énergie que les moteurs de recherche traditionnels. Une augmentation de l'efficacité est nécessaire selon René Haas pour éviter une crise énergétique, malgré l'expansion continue de la capacité informatique.

Pour en savoir plus: Wall Street Journal, The RegisterMicrosoft mise sur le Japon • Microsoft vient d'annoncer un investissement de 2,9 milliards de dollars (2,67 milliards d'euros) pour développer ses infrastructures cloud et IA au Japon, marquant le plus gros investissement de l'entreprise dans le pays en 46 ans. Cet investissement servira également à former trois millions de personnes à l'IA et à établir un laboratoire Microsoft Research Asia à Tokyo. Microsoft, qui investit 50 milliards de dollars (46 milliards d'euros) par an dans les datacenters d'Azure, envisagerait de développer pour OpenAI un datacenter d'un coût estimé à 100 milliards de dollars (93 milliards d'euros, lire Qant du 2 avril).

Pour en savoir plus: Reuters

MONNAIES NUMÉRIQUES ET BLOCKCHAINS

Monad Labs veut construire un nouvel Ethereum • Monad Labs a finalisé un tour de financement de 225 millions de dollars (207 millions d'euros) mené par Paradigm, avec pour objectif de construire une blockchain (“layer 1”) compatible avec la machine virtuelle Ethereum, un standard quasiment universel pour les smart contracts. La lenteur de la blockchain Ethereum, qui ne peut enregistrer que 10 transactions par seconde, provoque des coûts de transaction importants. Ainsi s’explique l’émergence de nouvelles blockchains comme Solana, mais la compatibilité des applications entre blockchains reste hasardeuse et demande de passer par une autre machine virtuelle, Neon EVM. La compatibilité permettra aux développeurs de transférer facilement leurs applications sur la future blockchain de Monad Labs, qui promet des transactions plus rapides, de plus grands volumes et des coûts inférieurs. Grâce à ce financement, Monad Labs prévoit de lancer un testnet puis son réseau principal dans les prochains mois, ciblant initialement le trading à haute fréquence.

Pour en savoir plus: FortuneLes ETF Bitcoin options devront attendre • La SEC américaine a reporté à fin mai sa décision concernant la proposition de la Bourse de New York d'offrir des options de trading sur les ETF Bitcoin au comptant de Bitwise et Grayscale. La nouvelle date limite fixée par la SEC pour approuver, refuser ou reporter à nouveau cette proposition est le 29 mai. Cette décision suit un report similaire pour le Nasdaq, qui avait demandé des options de trading pour le fonds Bitcoin de BlackRock. Alors que les ETF Bitcoin spot s'appuient sur une quantité réelle de bitcoins achetée par le fonds, les ETF Options ne détiennent pas directement de Bitcoin, mais investissent dans des contrats d'option sur Bitcoin. Ils sont donc beaucoup plus spéculatifs et s’apparentent aux ETN autorisées à Londres (lire Qant du 12 mars).

Pour en savoir plus: Cointelegraph

AR-VR-MR-XR

Réalité sans Frontière • La dernière mise à jour du casque Meta Quest 3 améliore la réalité mixte avec un passthrough de meilleure qualité, ajustant mieux couleur, exposition, contraste et gamme dynamique. Meta peut ainsi permettre à certains développeurs de désactiver la limite de sécurité ("boundary") dans les applications de réalité mixte sur Quest. Cela pourra améliorer l'expérience utilisateur en supprimant les barrières inutiles dans un environnement visible par le joueur. La mise à jour comprend aussi le support pour un microphone externe, pour la création de contenu ou pour le chat pendant un jeu. De plus, une fonctionnalité de casting continu a été ajoutée pour éviter l'interruption de la session lors du retrait du casque.

Pour en savoir plus: TechRadar

QUANTUM

Créer des fonctions d’activation quantiques • Une équipe de chercheurs notamment issus de l'Académie chinoise des sciences vient de présenter une étude qui développe des circuits quantiques intégrant des fonctions d’activation dans le Quantum Machine Learning (QML). Les fonctions d’activation introduisent des propriétés non linéaires dans un réseau neuronal. L’étude propose de nouvelles implémentations de deux d’entre elles, Relu (Rectified Linear Unit) et Leaky Relu, en ajustant le nombre de qubits en fonction de l’application recherchée. Les auteurs espèrent faire levier sur l’implémentation de fonctions d’activation pour créer des réseaux neuronaux quantiques.

Pour en savoir plus: Wei Zi et al., Efficient Quantum Circuits for Machine Learning Activation Functions, Arxiv, 9 avril 2024

ROBOTS

Un robot arc en ciel brille en Corée

RB-Y1, conçu par Rainbow Robotics, est le premier robot manipulateur mobile à deux bras conçu en Corée.

L'entreprise coréenne de robotique Rainbow Robotics a récemment présenté son nouveau robot, le RB-Y1, qui combine une base mobile à roues avec deux bras robotiques dotés de sept degrés de liberté et un torse capable de six mouvements. Cela lui permet de réaliser des actions à différentes hauteurs dans divers environnements.

Le RB-Y1 se distingue par sa capacité à se déplacer rapidement, avec une vitesse maximale d'environ 9 km/h, et à effectuer des virages serrés en inclinant son corps pour maintenir l'équilibre. Il mesure 1,40m de haut pour un poids de 131 kg, et chaque bras peut soulever jusqu'à 3 kg. Bien que les premières démonstrations du RB-Y1 aient été réalisées via téléopération, Rainbow Robotics vise à rendre le robot entièrement autonome à l'avenir, grâce à davantage de recherche, de développement et de simulation.

Elle le fera en collaboration avec le groupe allemand de mécanique Schaeffler et l'Institut coréen de technologie électronique (KETI), qui ont également contribué au développement de ce “premier manipulateur mobile bimanuel conçu en Corée”. L'accord vise à co-développer le RB-Y1 mais aussi d'autres manipulateurs mobiles, sans sacrifier à la mode des robots humanoïdes.

Au moins pour l’instant.

Pour en savoir plus :

ÉDITION PREMIUM

En exclusivité pour les abonnés :

La course s’est enclenchée entre Meta et Mistral pour savoir qui de Llama et Mixtral dominera les modèles open source. Après Large de Mistral, Meta prépare sa réplique : Llama3.

...