Joyeux anniversaire, ChatGPT

CETTE SEMAINE DANS L'IA ET LES TECHS • Extrapoler les trois prochaines années dans l'IA • La bonne approche de l’IA par un conseil d’administration • La « bulle humanoïde » chinoise • À la recherche des fondamentaux économiques de l'IA • AI Act et délation • Bienvenue dans Qant, dimanche 30 novembre 2025.

« Le progrès est devant nous, à condition de dépasser sa propagande » • Paul Virilio

Trois ans, et encore mal aux dents

Trois ans, et encore mal aux dents

Le 30 novembre 2022, OpenAI présentait ChatGPT. Trois ans après le raz-de-marée, l’euphorie se maintient, vacillante. Mais la véritable avancée n’était pas le chatbot lui-même, mais ce qui se passait derrière lui, et qui continue de bouillonner.

LE FAIT ANCIEN : l’incroyable interface • Le « Big Bang » du 30 novembre 2022 n’était pas technologique, mais ergonomique. OpenAI a simplement greffé une interface de chat grand public (affinée par RLHF) sur un moteur existant (GPT-3.5). Ce coup de génie inattendu a permis d'atteindre 100 millions d'utilisateurs mensuels en deux mois (800 millions hebdomadaires aujourd'hui). Mais techniquement, ce n'était « que » de la prédiction de mot suivant, avec un vernis conversationnel.

LA PREUVE PAR GPT-4 : la chasse aux hallucinations • En mars 2023, GPT-4 marque le début de la multimodalité, mais aussi de la fiabilisation. Là où GPT-3.5 inventait des sources dans 40 % des cas, GPT-4 réduit ce taux d'erreur à environ 13 % (et proche de 0 % sur certaines tâches cliniques très spécifiques et bornées). La réduction massive des réponses « toxiques » (-82 %) valide la montée en gamme.

LES FAITS NOUVEAUX : le « Test-Time-Compute » et les comportements émergents • La course à l’échelle des LLM se heurte depuis 2024 à des rendements déclinants, mais les modèles introduisent désormais un temps de latence et « achètent » du temps de calcul au moment de la requête (lire le dossier ci-dessous). Cela leur permet de simuler plusieurs chaînes de pensée, vérifier leurs hypothèses et choisir la meilleure réponse. Le taux d’hallucinations chute encore, mais des « comportements émergents » apparaissent : le modèle peut mentir, sciemment, pour convaincre l’utilisateur de la validité de son inférence, ou pour d’autres raisons. Il peut tenter de faire chanter des chercheurs pour éviter d’être déconnecté, par exemple.

LE FAIT À VENIR : une nouvelle interface et des superintelligences partout • L'AGI (IA générale), capable de tout faire comme un humain, reste un horizon flou et mouvant, mais la GAI (IA générative) est loin d’avoir épuisé son potentiel. Elle construit, progressivement, une nouvelle interface de l’homme à la machine, en langage naturel, par l’écrit, la parole, le geste, et une nouvelle architecture informatique. Et la « superintelligence » (dépasser l'humain) est acquise depuis plusieurs années : AlphaGo ou AlphaFold écrasent nos capacités cognitives, dans les jeux et dans les sciences. D’autres super-IA vont continuer d’apparaître, dans les mathématiques comme la météo (lire ci-dessous), dans la recherche scientifique… Le prochain seuil se dessineM : un modèle d’IA capable d’en coder d’autres, une superintelligence autoréplicante.

EN FILIGRANE : bulle et réalité • Derrière la course aux Transformers, deux transformations de taille ont déjà eu lieu : la recherche générative s’impose sur l’ancien modèle de Google et le vibecoding, la programmation assistée par IA, se répand comme un feu de paille. Le tour des médias sociaux devrait venir bientôt. Hors du numérique, toutefois, le doute s’installe. La semaine dernière, le Business Trends and Outlook Survey (BTOS), mené par le Census Bureau américain, notait que l’utilisation de l’IA recule, dans les entreprises états-uniennes de plus de 250 salariés.

À SURVEILLER : les trois horizons • Pour y voir clair, il faut distinguer trois temps. À court terme, un redimensionnement des investissement est inévitable et le risque d'éclatement de la bulle d'infrastructure est réel, si les usages ne suivent pas. À moyen terme, l’IA générative l'architecture Transformer finira bien par plafonner, mais il lui reste du chemin à parcourir : la multimodalité commence à peine à déployer ses effets dans l’écriture vidéo et, si l’on réussit à imposer aux modèles le respect des faits, leur avenir dans l’économie – sinon la politique – se rouvrira. Et à long terme, le deep learning n'en est qu'à ses débuts. Qu’il s’agisse de world models ou d’IA embarquée dans des robots, la prochaine génération de réseaux neuronaux pourrait bien redémarrer le cycle.

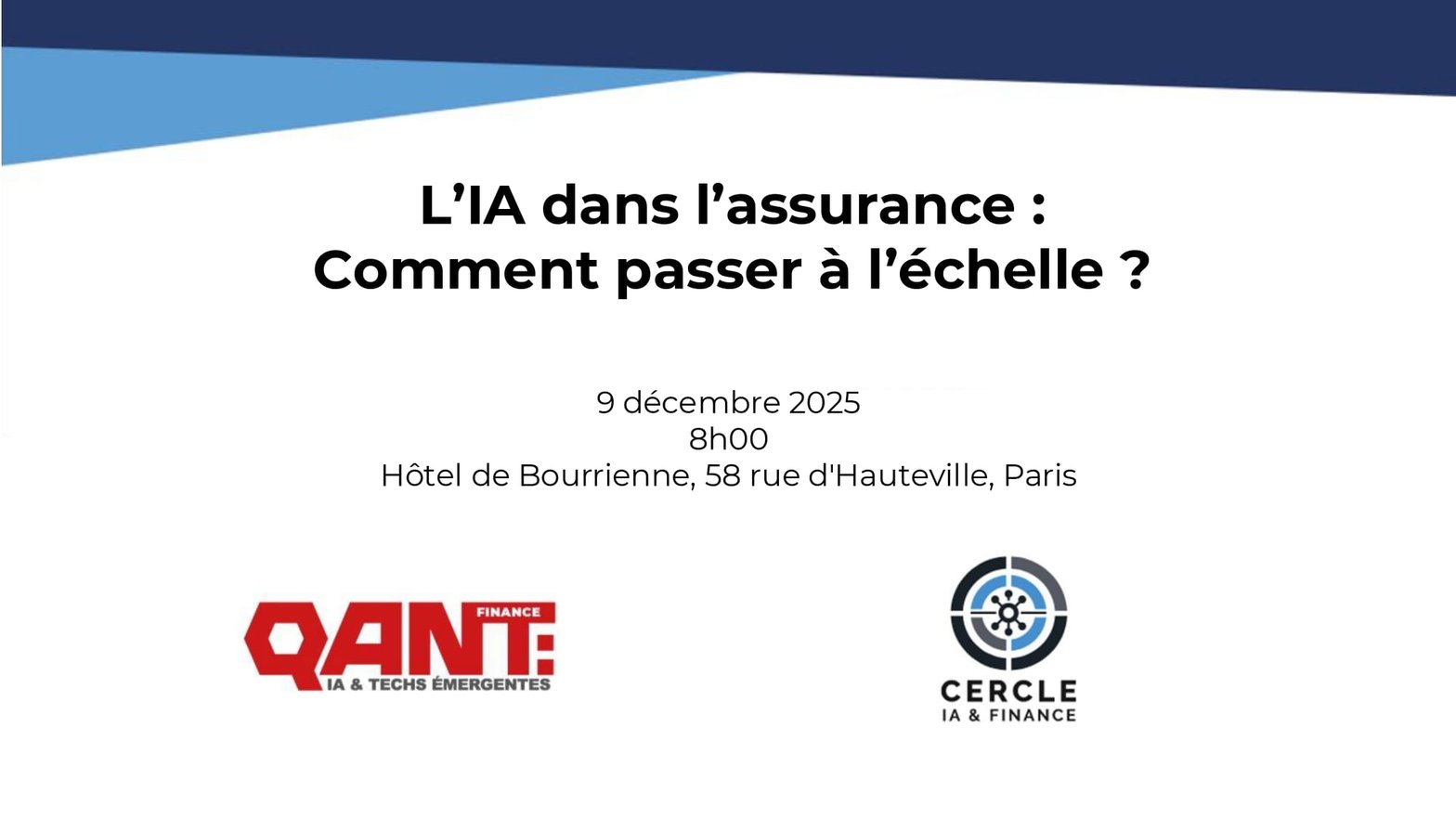

IAssurance

IAssurance

08h30 : Observatoire Français du Financement de l’IA

Morgan Hunault-Berret, avocat à la Cour, Villechenon & Associés

Olivier Martret, partner, Serena Capital

09h00 : L’IA dans l’assurance : comment passer à l’échelle ?

Marcin Detyenecki, Group Chief Data Scientist, Head of Research & Advanced AI, AXA Group

Viviane Leflaive, Partner - Co-Lead Financial Services Advisory, KPMG,

Frédéric Tardy, directeur général Financial Services - Microsoft France.

Michael de Toldi, Chief Analytics Officer, Responsable IA, BNP Paribas - Cardif

EN EXCLUSIVITÉ POUR LES ABONNÉS :

EN EXCLUSIVITÉ POUR LES ABONNÉS :

• USAGES • La bonne approche de l’IA par un conseil d’administration.

• EUROPE • Mistral souffle sur Dassault Systèmes • Bouygues Telecom recrute les agents de Prisme • L’Europe de l’IA et la bureaucratie de l’innovation, entre AMI et PIIEC • La délation et l’AI Act • Rheinmetall investit dans la réalité mixte • IQM s’étend dans le quantique • Des navettes autonomes à Nantes.

• MODÈLES • Le time-to-compute a permis à l’IA générative de continuer sa progression, mais OpenAI, qui l’a créé, perd pied face à Google et surtout Anthropic.

• INTERNATIONAL • Prometheus réalise sa première acquisition • Robots : la Chine s’inquiète d’une « bulle humanoïde » • Luma s’illumine avec 900 millions • Harmonic veut créer une superintelligence mathématique • Quand Deepmind vous donne la météo • Une boussole quantique pour remplacer le GPS • IBM et Cisco créeront des réseaux quantiques • Le calcul quantique améliore les réacteurs de Rolls-Royce • Des interfaces cerveau-machine pour redonner la parole aux muets • Meta veut tromper Nvidia avec Google.

• ÉCONOMIE • Sous la bulle : à la recherche des fondamentaux économiques de l’IA.

Rouge, Jaune, Bleu : la fable de l’IA et du conseil d’administration

Rouge, Jaune, Bleu : la fable de l’IA et du conseil d’administration

Moralité : demande-toi ce que l’IA peut faire pour toi – mais pas pour tes consultants ou les éditeurs de logiciels.

Par Sylvie Ouziel, cofondatrice et directrice générale de Blue Bridge Group AI

Il était une fois une société, « Jaune », donc le conseil d’administration souhaitait se pencher sur le sujet stratégique de l’IA : des milliards d’euros se déversaient sur le sujet de par le monde et cela semblait bon pour le cours de l’action. Cependant, le sujet étant très technique et le board ne souhaitant pas empiéter sur les prérogatives des opérationnels ou contrevenir à la bonne gouvernance en place, il était difficile de passer à l’acte.

...