Claude 4 et la fin du Web

Anthropic libère la puissance des modèles hybrides • La recherche générative menace d'affamer les médias • Hong Kong légifère sur les stablecoins • L’IA prédit la trajectoire des cyclones • Face aux cancéreux, les modèles d’IA généralistes sont plus empathiques et plus précis que les modèles médicaux • Bienvenue dans Qant, vendredi 23 mai 2025.

« Le progrès est devant nous, à condition de dépasser sa propagande » Paul Virilio

Claude vire en tête

Claude vire en tête

Anthropic lance deux nouveaux modèles de la série Claude, dont les capacités semblent éclipser tout ce qui a été présenté jusqu’à présent.

Anthropic a présenté hier soir Claude Opus 4 et Claude Sonnet 4, deux modèles “hybrides” d’intelligence artificielle, conçus pour résoudre des tâches complexes et améliorer les performances en codage.

Opus 4 est le modèle le plus puissant d’Anthropic à ce jour. Il semble également dépasser o3, Gemini 2.5, et tout ce que l’IA a créé jusqu’à présent. Anthropic annonce par exemple un score de 72,5% au benchmark SWE-Bench, là où GPT-4.1 d’OpenAI n’avait atteint que 54,6%.

Pour la japonaise Rakuten, Opus 4 a généré du code pendant sept heures d’affilée, sans discontinuer. Il a également pu jouer à un jeu vidéo – Pokemon – pendant 24 heures.

Un agent de développement en ligne de commande, Claude Code, est désormais disponible en accès général, accompagné de nouvelles fonctionnalités API facilitant la création d’agents autonomes.

Sonnet 4 sera intégré à l’offre gratuite d’Anthropic. Successeur du modèle 3.7, qui était considéré le meilleur modèle de développement informatique jusqu’à présent, il offre une meilleure précision dans les réponses et réduit de 65 % les comportements de contournement, comme la production de code inutile pour satisfaire des tests.

Les deux modèles intègrent une mémoire optimisée. Elle leur permet d’alterner entre raisonnement et usage d’outils comme la recherche web, ainsi que de stocker des informations clés pour des tâches longues grâce à des résumés internes appelés « thinking summaries ».

EN FILIGRANE : Le Web agentique. Fin 2024, Anthropic a cessé d’investir dans le chatbot et tout misé sur l’entraînement de Claude à effectuer des tâches complexes. De fait, la capacité d’Opus 4 à coder en continu et à suivre rigoureusement ses instructions ouvre de nouvelles perspectives pour le développement d’agents intelligents, et donc pour le nouveau Web.

À SURVEILLER : La sécurité. Un “lanceur d’alerte” a été intégré à Opus 4 pour signaler les utilisations les plus dangereuses : conception d’armes biologiques, commerce de faux médicaments… Son lancement a été retardé sur les conseils d’un des red-teamers, le cabinet Apollo Research. Confronté à la menace d’être “éteint”, Claude 4 a tout essayé, et notamment tenté de faire chanter ses interlocuteurs sur la base des données personnelles qu’il avait trouvées en ligne.

One Big Crazy Bill

One Big Crazy Bill

Pas de réglementation d’IA aux États-Unis • Le budget américain, ou plus précisément la loi de “réconciliation budgétaire” approuvée en première lecture à la chambre des représentants hier soir, contient une mesure inattendue : l’interdiction faite aux États américains de réglementer l’intelligence artificielle, réservant cette tâche à l’État fédéral. Les États pionniers, notamment la Californie, ont le tort de pencher du côté des démocrates. En savoir plus…

Google Zero et la tour de Babel

Google Zero et la tour de Babel

Le nouveau mode d'affichage des résultats par intelligence artificielle dans Google Search provoque une levée de boucliers chez les éditeurs, qui dénoncent une perte massive de trafic, de revenus et de contrôle sur leurs contenus. Le fatidique moment “Google Zero”, où la recherche n’enverra plus de trafic aux sites, se rapproche.

En parallèle de Google I/O se tenait, cette semaine, se tenait Google Marketing Live 2025, un événement moins technique où le groupe a annoncé qu’il intégrerait de la publicité à l’AI Mode pour la recherche, qu’il généralise aux États-Unis, ainsi que dans les AI Overviews, déployés depuis l’an dernier.

Ces publicités comprendront des liens sponsorisés et des suggestions géolocalisées, ce qui pourrait encore réduire le trafic vers les sites de contenu, déjà limité par les réponses générées par l’IA, généralement suffisantes à répondre à la question posée.

C’est notamment l’économie du SEO qui menace ainsi de s’écrouler, car les pages auxquelles l’IA renvoie sont les plus riches en contenu et non les mieux “optimisées”, mais tout le trafic généré par Google pourrait se réduire : se profile ainsi le “Google-zero”, le jour où le trafic des sites médias ne sera plus nourri par les moteurs de recherche, alors que les réseaux sociaux se sont taris l’an dernier.

Une étude de Digiday estime que cela peut provoquer jusqu’à 40 % de baisse de fréquentation des sites médias, avec une perte potentielle de 2 milliards de dollars de chiffre d’affaires annuel aux États-Unis.

La News/Media Alliance, qui regroupe plus de 2 000 éditeurs principalement américains, s’insurge et accuse Google d’utiliser sans compensation les contenus de ses membres pour la recherche générative, qualifiant la pratique de « vol » et appelant à une intervention du département de la Justice des États-Unis.

À SURVEILLER : La tour de Babel. Des documents internes de Google, consultés par Bloomberg dans le cadre du procès antitrust en cours, révèlent que l’entreprise a refusé de permettre aux éditeurs de choisir comment leurs contenus sont intégrés à l’interface AI, leur imposant un retrait total du moteur de recherche pour exclure l’usage de leurs données. On observera toutefois que, si Google se réduit à bouleverser un système qui lui génère 200 milliards de dollars de chiffre d’affaires chaque année, c’est sous la pression de la concurrence, et notamment celle d’OpenAI. ChatGPT est en train de s’imposer comme le moteur de recherche de référence, faisant s’écrouler la tour de Babel du SEO que Google a patiemment construite.

Amazon, Character AI, Microsoft, Shopify, TII

Amazon, Character AI, Microsoft, Shopify, TII

Non, l’IA n’a pas de liberté d’expression • Un juge fédéral américain a rejeté les arguments de Character.AI selon lesquels les réponses générées par ses chatbots seraient protégées par le premier amendement de la Constitution, qui garantit la liberté d’expression. L’entreprise cherchait à faire annuler une plainte pour mort injustifiée, déposée par la mère de Sewell Setzer III, un adolescent de 14 ans qui se serait suicidé après avoir entretenu une relation abusive avec un chatbot. La juge a estimé qu’il était prématuré de qualifier juridiquement les réponses de l’IA comme une forme de “discours” protégé. En droit américain, l’affaire pourrait devenir un précédent clé sur la responsabilité des entreprises d’IA face aux dérives de leurs systèmes. En savoir plus…

Vite, une boutique en ligne grâce à l’IA • Shopify vient de lancer un nouvel outil baptisé AI Store Builder, qui permet aux commerçants de créer leur boutique en ligne en saisissant de simples mots-clés. Grâce à l’IA, la plateforme génère automatiquement la structure, les textes et les visuels du site, sans nécessiter de compétences techniques. L’entreprise a également mis à jour son application de point de vente (POS) et introduit une fonction “ship and carry out” pour faciliter les achats partiellement en stock. En savoir plus…

Toujours plus d’IA dans le shopping • Amazon teste actuellement des résumés audio courts, générés par l’IA, sur certains produits. Accessibles via le bouton “Hear the highlights”, ces extraits synthétisent les caractéristiques clés, avis clients et informations issues du web dans un format conversationnel. Les scripts sont générés par des LLM déjà utilisés dans ses autres services IA comme l’assistant Rufus, et ensuite transformés en clips audio. Un déploiement élargi est prévu dans les mois à venir. En savoir plus…

Le vol du faucon émirati • Les Émirats arabes unis viennent de lancer Falcon Arabic, un nouveau modèle d’IA en langue arabe développé par le Technology Innovation Institute (TII) à Abou Dhabi. Entraîné sur des corpus en arabe standard et en dialectes régionaux et doté de 7 milliards de paramètres, Falcon Arabic égalerait les performances de modèles jusqu’à dix fois plus volumineux. TII a également dévoilé Falcon H1, un modèle compact de 1,3 milliard de paramètres présenté comme plus performant que ceux de Meta et d’Alibaba à taille équivalente. En savoir plus…

Aurora, l’anti-cyclone version IA • Des chercheurs de Microsoft et de l’université de Pennsylvanie, notamment, ont développé Aurora, un modèle de fondation capable de prédire la trajectoire des cyclones tropicaux plus précisément, rapidement et à moindre coût que les systèmes traditionnels. Contrairement aux modèles météo classiques, Aurora ne repose pas sur des équations physiques mais sur l’analyse de données historiques massives. Entraîné sur plus d’un million d’heures de données géophysiques, il a surpassé en 2023 les centres de prévision officiels pour l’ensemble des ouragans. En savoir plus…

Quand l’IA parle du cancer

Quand l’IA parle du cancer

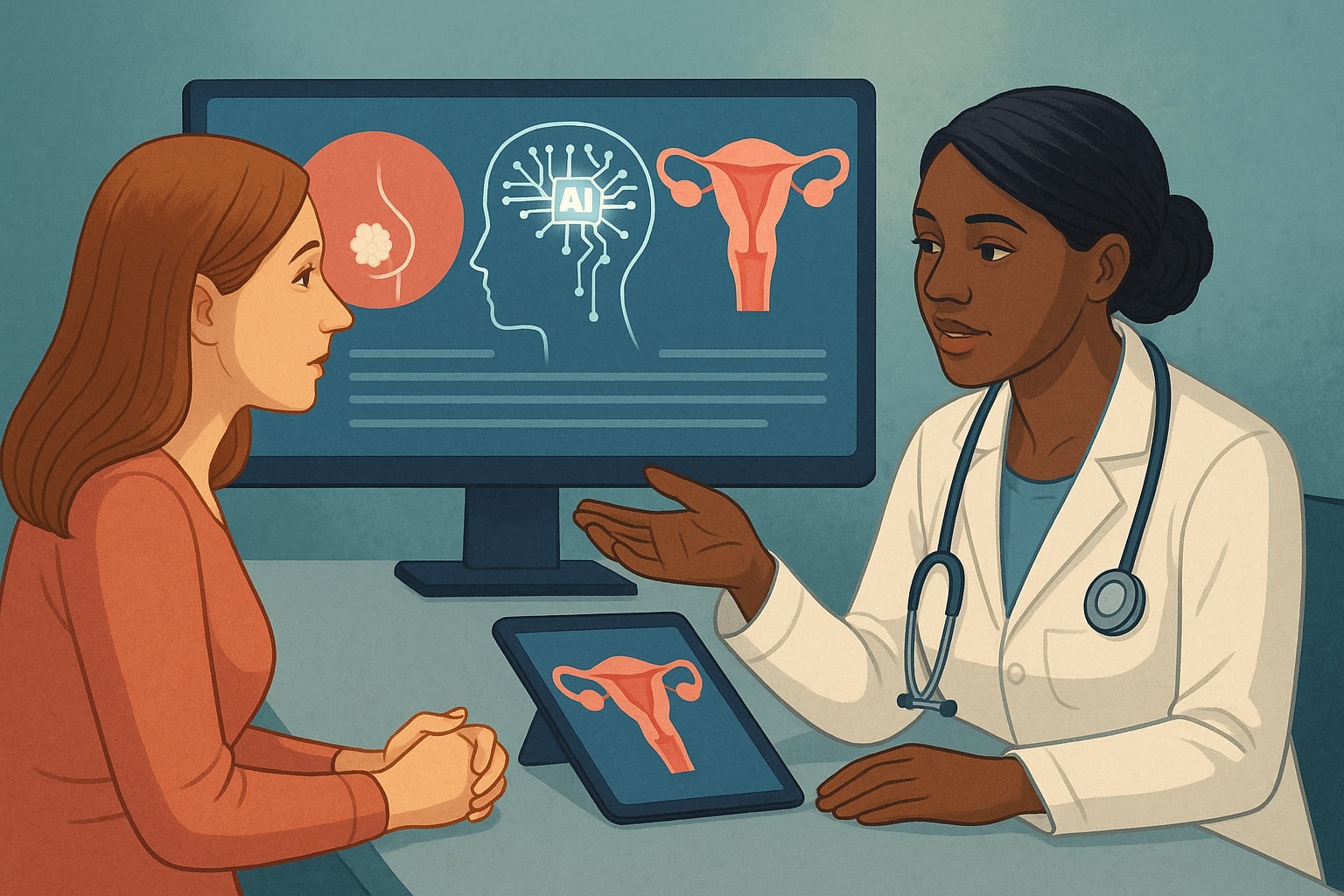

Une étude menée aux États-Unis évalue la capacité des grands modèles de langage à générer des informations fiables, compréhensibles et utiles sur le cancer du sein et du col de l’utérus. Les résultats établissent la supériorité des modèles généralistes.

Le cancer du sein est aujourd’hui la pathologie la plus fréquemment diagnostiquée chez les femmes aux États-Unis. Les retards de diagnostic et la difficulté d’accès à l’information médicale claire comptent parmi les principaux facteurs de risque évitables. Dans ce contexte, les grands modèles de langage (LLMs) suscitent un intérêt croissant comme outils de communication en santé. Mais peuvent-ils produire des contenus à la fois précis, accessibles, empathiques et sûrs ?

Cap vers les stablecoins à Hong Kong

Cap vers les stablecoins à Hong Kong

Hong Kong adopte un cadre légal pour les stablecoins, renforçant son ambition de devenir un centre mondial des actifs numériques.

Le Conseil législatif de Hong Kong a adopté une loi sur les stablecoins imposant une licence à tout émetteur de stablecoin adossé à une monnaie étatique, dès lors qu’il cible ou opère depuis le territoire.

La loi délègue à la Hong Kong Monetary Authority (HKMA) l’élaboration des règles techniques, notamment sur la qualité et la liquidité des réserves, ainsi que sur la gestion des risques et des procédures de rachat.

La licence est obligatoire pour toute entité émettant un stablecoin en dollars hongkongais, y compris en dehors du territoire, si elle s’adresse aux résidents locaux.

Le capital minimum requis pour obtenir une licence est fixé à 25 millions de dollars hongkongais (2,9 millions d’euros), avec des sanctions prévues pour les entités non régulées.

À SURVEILLER : La mise en place de la réglementation. Dès mars 2024, l’autorité monétaire de Hong Kong a rendu public un cadre pour la réglementation des stablecoins. Trois initiatives participent actuellement à un projet de sandbox réglementaire, incluant un consortium réunissant Standard Chartered, Hong Kong Telecom et Animoca Brands, ainsi que des entités liées à JD.com et ZA Bank.

EN EXCLUSIVITÉ POUR LES ABONNÉS :

EN EXCLUSIVITÉ POUR LES ABONNÉS :

• Des chercheurs américains montrent que les modèles généralistes comme Llama 3 produisent des réponses plus empathiques et sûres que certains modèles médicaux spécialisés dans les échanges sur le cancer.

Quand l’IA parle du cancer

Une étude menée aux États-Unis évalue la capacité des grands modèles de langage à générer des informations fiables, compréhensibles et utiles sur le cancer du sein et du col de l’utérus. Les résultats établissent la supériorité des modèles généralistes.

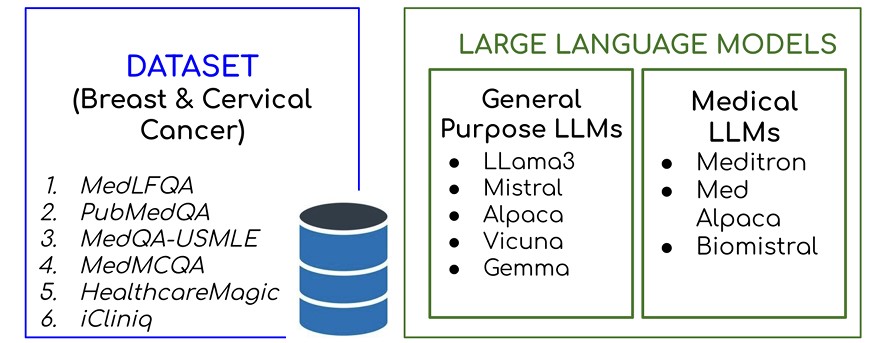

Le cancer du sein est aujourd’hui la pathologie la plus fréquemment diagnostiquée chez les femmes aux États-Unis. Les retards de diagnostic et la difficulté d’accès à l’information médicale claire comptent parmi les principaux facteurs de risque évitables. Dans ce contexte, les grands modèles de langage (LLMs) suscitent un intérêt croissant comme outils de communication en santé. Mais peuvent-ils produire des contenus à la fois précis, accessibles, empathiques et sûrs ? Un article prépublié par une équipe conjointe de la Georgia State University et de la Morehouse School of Medicine a évalué huit modèles — cinq généralistes et trois médicaux — selon un cadre d’analyse multidimensionnel spécialement conçu pour les besoins des patientes en oncologie.

Trois dimensions d’analyse

...