L'été, l'IA se met au sport

Pendant que le Glossaire Critique remonte vers les sources de l'apprentissage profond et qu'OpenAI et Google tentent de séduire les journaux , Qant part à la rencontre de l'IA dans le sport. Et de ses étonnants deep fakes.

« Le progrès est devant nous, à condition de dépasser sa propagande » Paul Virilio

Chaque semaine l’été et chaque jour le reste de l’année, les journalistes de Qant illustrent les tendances de fond qui animent la tech. Pour cela, ils s’appuient sur Kessel Média et utilisent l’IA générative depuis mars 2022.

CORN FAKES :

Les matins d’été, rien de tel qu’un bol d’IA

Quand les fakes remportent le match

De Wimbledon à l’Australie, l’IA se glisse partout dans le monde du sport. Et la coupe revient aux deep fakes.

“Il n’y a que les Bleus pour nous procurer ses émotions. Pourtant, ce n’est pas eux que vous venez de voir”.

Pour un amateur de sport, il était difficile ces dernière semaines de passer à côté du spot publicitaire d’Orange à l’occasion de la Coupe du monde de football féminin qui a démarré ce jeudi 20 juillet en Australie et en Nouvelle-Zélande. Le concept de la vidéo : une compilation d’actions de classe réalisé par l’équipe de France masculine et ses stars biens connues. Puis un message indiquant que ces actions sont en réalité l’œuvre de l’équipe féminine, et qu’elles sont été retouchées grâce à l’IA. Le biais du spot est assumé : lutter contre le cliché d’un football féminin faible techniquement et mettre en exergue les préjugés qui sous-tendent ce cliché. Réalisé par l’agence Marcel, il a été vu 4,8 millions de fois sur le chaîne Youtube d’Orange France, alors que les vidéos des Bleues sur celle de la Fédération française de football n’atteignaient pas les 30 000.

Dépourvus de vie et de passion, les commentaires par Watson d’IBM des matches de Wimbledon – conclus dimanche 16 – n’ont pas obtenu le même succès. Générés à partir des extraits vidéos proposés sur Wimbledon.com, ces commentaires audios n’en représentent pas moins une première technique d’importance. De toute évidence, il est devenu possible d’entraîner un robot génératif sur la voix de Nelson Monfort, en conférant à ce dernier une forme d’immortalité. Mais il conviendra de vérifier son consentement…

Au printemps, le tabloïd allemand Die Aktuelle avait fait scandale en publiant une interview de l’ancien pilote de Formule 1 Michael Schumacher, qui n’a pas été vu en public depuis son accident de décembre 2013. Cette interview imaginaire avait été rédigée par Character.ai et, par pérécaution, le magazine se demandait si elle n’était pas “trop belle pour être vraie”. Rien n’y a fait : Funke Mediengruppe, éditeur de Die Aktuelle, a annoncé quelques jours plus tard le licenciement de la rédactrice en chef Anne Hoffmann et présenté ses excuses à la famille Schumacher, qui n’en a pas moins confirmé son intention de poursuivre en justice le magazine. Character.ai, pour sa part, a réalisé une des plus belles levées du premier semestre (lire Qant du 12 juin).

Toucher de balle, deux lettres

L'impact de l'IA sur le monde du sport ne se limite pas aux médias et à la publicité. La GenAI est par exemple en train de transformer le recrutement, avec l'utilisation de la computer vision pour analyser des quantités toujours plus importantes de données sur les performances de joueurs. Au Canada, l'entreprise Sportlogiq utilise par exemple l'IA pour proposer des analyses poussées à différents clients, notamment la Ligue nationale de hockey. Dès 2020, l’US Open a remplacé ses juges de ligne par Hawk-Eye Live, un système de modélisation de la trajectoire de la balle en 3D qui se targue d’une précision de 3,6 millimètres. Aidé par la pandémie, le système a fait tache d’huile (et de nombreux mécontents).

Dans tous les sports, des logiciels et des modèles d’IA permettent désormais d’analyser les stratégies des joueurs. Mais rien n’a encore égalé Stanford, qui en 2021 a proposé le plus beau des fakes de tennis : Roger Federer jouant contre lui-même à Wimbledon.

Roger Federer jouant à Wimbledon contre Novak Djokovic, Serena Williams et contre lui-même.

Pour en savoir plus :

L’ESSENTIEL :

De l’actu, mais rien que la substantifique moëlle

IA GÉNÉRATIVE

Llama 2 en appelle à Azure : Meta vient de lancer Llama 2, une nouvelle famille de modèles de langage de 7 à 70 milliards de paramètres, disponible en open source mais aussi sur le cloud de Microsoft, Azure, et à terme sur AWS et Hugging Face. Doté désormais d'une licence commerciale, Llama 2 exclut les titulaires ayant plus de 700 millions d'utilisateurs actifs quotidiens et restreignant l'utilisation des contenus ainsi générés pour améliorer d'autres modèles de langage. Le berger répond ainsi à la bergère OpenAI, dont les modèles sont également disponibles sur Azure. Le premier Llama, en effet, n’avait pu être commercialisé car il avait été entraîné sur des contenus générés par OpenAI.

Pour en savoir plus: Ars TechnicaGenesis, la solution de Google pour aider les journalistes (NYT) : Google a présenté un outil d'IA capable de rédiger des articles de presse, nommé Genesis, à des dirigeants du New York Times, du Washington Post et de News Corp, propriétaire du Wall Street Journal, en le présentant comme un complément aux journalistes plutôt qu'un remplaçant.

Pour en savoir plus: The VergeOpenAI offre 10 millions à la presse régionale américaine : OpenAI vient de nouer un partenariat avec l'American Journalism Project (AJP), une association qui soutien la presse régionale américaine (ou ce qu’il en reste), en s'engageant à fournir 5 millions de dollars en espèces et 5 millions de dollars en crédits API, permettant ainsi aux entreprises membres de l'AJP de développer des applications utilisant les technologies d'OpenAI.

Pour en savoir plus: Venture BeatBard chante en Europe : Google vient de lancer son chatbot Bard dans plus de 40 langues. L’entreprise le propose enfin dans l'Union européenne, avec plusieurs mois de retard initial attribués aux exigences du RGPD sur la protection des données. Tirant parti de la multimodalité de Palm 2, Bard accepte des images dans ses invites (“prompts”) et peut lire ses réponse à voix haute.

Pour en savoir plus: Tech Crunch

AR-VR-XR-MÉTAVERS

Artemis oriente Meta vers le petit gibier : Selon le média américain The Information, Meta arrête ses travaux sur les casques de réalité mixte haut de gamme Quest Pro, pour se concentrer sur des casques plus abordables comme le Quest 3. De plus, ses premières lunettes de réalité augmentée, dont le nom de code est Artemis, n'incluront pas les affichages haut de gamme initialement prévus pour l'appareil, et utiliseront plutôt une technologie d'affichage plus ancienne, les écrans à cristaux liquides sur silicium (LCoS). Les deux informations indiquent toutes deux que Meta abandonnerait le haut de gamme (et donc l’innovation de pointe) à Apple et Samsung (lire Qant du 6 juin et du 3 mars).

Pour en savoir plus: The Verge

BLOCKCHAINS

L’AMF lance la Forge (Les Échos) : SG Forge, la filiale de la Société Générale spécialisée dans les crypto actifs, est la première entreprise à avoir obtenu de l'Autorité des marchés financiers un agrément en tant que Prestataire de services sur actifs numériques (Psan), et non simplement un enregistrement. Les exigences en matière de cybersécurité, de garantie de liquidité et de contrôle interne sont bien plus sévères, mais cela fait de Forge l’acteur français le plus proche du statut de Casp (crypto-asset service provider) prévu par le règlement européen Mica, qui entrera en vigueur l’an prochain. Au printemps, Forge avait lancé un stablecoin euro (lire Qant du 27 avril).

Pour en savoir plus: Capital

QUANTIQUE

Les ions de Bâle : IonQ et QuantumBasel viennent de signer un partenariat stratégique dont l'ambition est de transformer la Suisse en un centre névralgique européen du calcul quantique, avec la mise en place d'un centre de données quantiques et l'installation de deux ordinateurs quantiques avancés, soutenus par un financement privé de 500 millions de dollars.

Pour en savoir plus: Forbes

GLOSSAIRE CRITIQUE :

Les mots pour savoir de quoi on parle

Là où naissent « les IA »

Depuis l’engouement du grand public pour ChatGPT, de nombreuses expressions techniques deviennent d’un usage de plus en plus courant : chatbot, LLM, hallucination… Au cours de l’été, Qant revient sur les principales d’entre elles, à commencer par la plus vague : « Intelligence artificielle ».

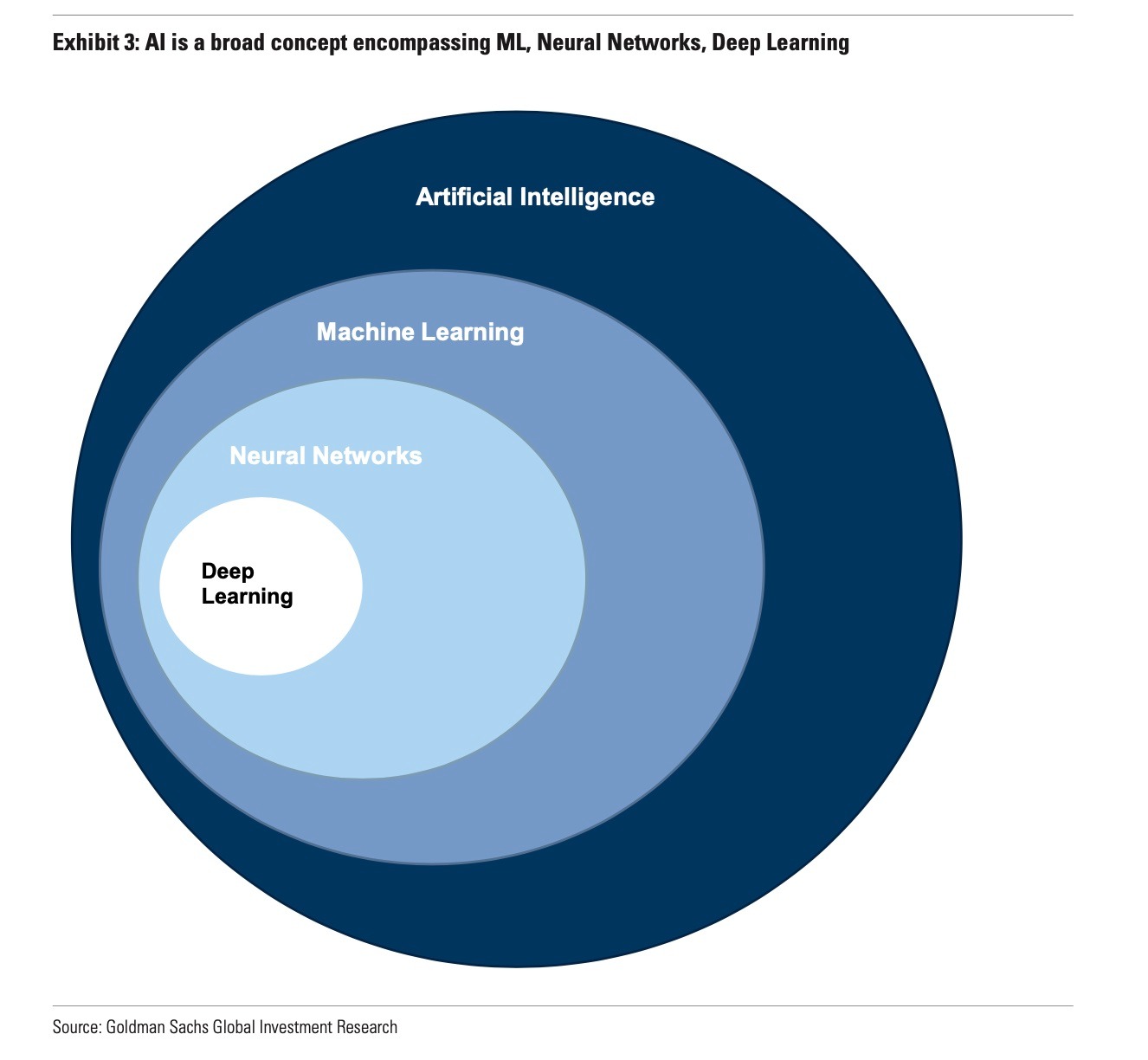

Comme pour « technologie », la définition de l’intelligence artificielle (IA) est devenue si floue qu’elle en perd tout son sens. L’engouement général pour ChatGPT et les modèles de langage naturel a parachevé une tendance qui serpentait depuis plusieurs années. Tout nouveau logiciel, aujourd’hui, est « une IA » ou du moins promet d’apporter la « révolution de l’IA » dans votre entreprise, votre ordinateur, votre téléphone.

Quand les traitements de texte intègrent des fonctionnalités pour composer de nouveaux textes à partir d’une invite et transformer le produit en présentation par diapositives, où s’arrête le logiciel et où commence l’IA générative ? Toute l’informatique et tout le numérique, distinction toujours fragile, font désormais partie intégrante de « l’ensemble de théories et de techniques mises en œuvre en vue de réaliser des machines capables de simuler l'intelligence humaine », selon la définition de l’IA par Larousse (reprise par Wikipédia).

Comme pour la « tech », il faut donc se résigner à l’idée que l’IA n’indique plus grand-chose de précis, avec un lien quelconque avec la machine universelle d’Alan Turing en 1936. Les usages aggravent le flou. En 2022, on pouvait encore séparer l’IA générative (GenAI) des modèles précédents, qui animaient des robots ou battaient à leurs propres jeux les champions d’échecs (DeepBlue) ou de go (AlphaGo). Et, au sein de la GenAI, distinguer les transformers, qui généraient des textes, des GAN, qui produisent des images. Mais cette année, les transformers multimodaux font tout converger au sein du même espace vectoriel et les robots s’animent grâce à la GenAI, ce qui promet un nouveau printemps à la robotique (lire Qant du 13 juillet).

Ne dites plus algorithme mais… modèle

La distinction entre les anciens systèmes experts – dont certains pourtant continuent de tourner – et les diverses méthodes d’apprentissage automatique (machine learning) ne semble pas plus fructueuse, au fur et à mesure que ces dernières se généralisent et se précisent. L’ensemble de l’IA générative se base sur des réseaux neuronaux, des modèles inspirés des cerveaux des mammifères et organisés en couches. Plus ou moins à l’instar d’un neurone, chacun des nœuds (nodes) interconnectés reçoit des données d'entrée, effectue un calcul et produit une sortie transmise à un autre neurone, et ainsi de suite. On ne parle plus ici d’algorithmes, qui sont des ensembles d’instructions reliées à une tâche, mais de modèles qui apprennent à représenter des données.

On retrouve ces réseaux neuronaux jusque dans des capteurs. Mais le sous-ensemble le plus important est celui de l’apprentissage profond (deep learning), qui se distingue des réseaux neuronaux moins profonds par le nombre de couches de calcul « cachées » entre l’entrée et la sortie. C’est ici que naissent les modèles les plus puissants, comme Alpha Fold 2, dont les calculs promettent de bouleverser la biologie moléculaire, et les transformers, comme GPT-4. Ces derniers promettent de remplacer l’intelligence artificielle, concept de plus en plus vaporeux, par l’IA générale (AGI) ou par la super-IA (ASI), des idées qui elles deviennent de plus en plus précises.

Et dont nous parlerons vendredi prochain.