La collaboration internationale sur l'IA se structure

Pendant que la Russie s'inquiète du monopole occidental sur l'IA, 21 agences dont l'Anssi française adoptent des lignes directrices pour la sécurité de l'IA. Bienvenue dans Qant, qui étudie le feedback humain pour entraîner les robots, ce mardi 28 novembre 2023.

« Le progrès est devant nous, à condition de dépasser sa propagande » Paul Virilio

Chaque jour, les journalistes de Qant illustrent les tendances de fond qui animent la tech. Ils s’appuient sur Kessel Média et utilisent l’IA générative depuis mars 2022.

L’ÉVÉNEMENT

Sécuriser l’IA dès sa conception

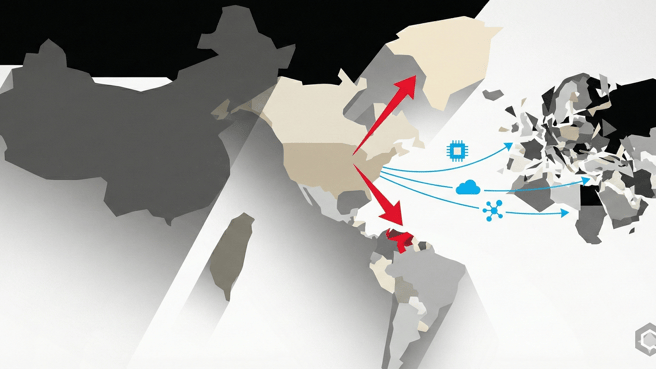

L’Anssi, pour la France, s’est jointe à ses homologues aux Etats-Unis, au Royaume-Uni et dans quinze autres pays pour adopter une série de lignes directrices qui veulent importer dans l’IA la “Security by design”.

Le sommet de Bletchley Park porte ses premiers fruits (lire Qant du 6 novembre). Le National Cyber Security Centre britannique vient de publier des lignes directrices pour le développement sécurisé des systèmes d'IA, développées en collaboration avec l’Anssi française, la Cisa américaine et nombre de leurs collègues : au total, 21 agences et ministères de 18 pays, dont tous les membres du G7.

Premières normes de sécurité de l’IA à être adoptées à l’international, quoique sur une base non contraignante, ces directives veulent proposer un chemin clair pour intégrer les principes de "sécurité par conception" dans les systèmes d’IA. Elles couvrent toutes les phases du déploiement des systèmes d'IA : la conception, le développement, le déploiement et enfin l'opération et la maintenance. A chaque étape, elle propose des chemins pour réduire les risques de sécurité.

Le document propose des recommandations générales, telles que la surveillance des systèmes d'IA pour prévenir les abus, la protection des données contre les altérations et l'évaluation des fournisseurs de logiciels. Il n'aborde pas les questions de droit d’auteur, de collecte des données ni d'utilisation appropriée de l'IA, mais il traite de la manière de protéger la technologie d'IA contre le piratage.

Entre Bletchley Park et l’AI Act

En attendant l’AI Act, plusieurs pays européens comme la France, l'Allemagne et l'Italie ont récemment conclu un accord sur la réglementation de l'IA qui soutient l'autorégulation obligatoire par des codes de conduite pour les modèles de fondation (lire Qant du 21 novembre). Une trentaine d’associations européennes, sous la houlette de Digital Europe, ont ensuite publié une lettre ouverte qui appelle le législateur européen à plus de laisser faire (pour la France, l’Afnum et Numeum ont répondu à l’appel).

Outre-Atlantique, la Cisa (l’agence américaine de cybersécurité) a récemment publié une feuille de route pour promouvoir les utilisations bénéfiques de l'IA et décourager les usages malveillants, tout en améliorant les capacités de cybersécurité pour que l'IA ne puisse pas menacer les infrastructures critiques. Cela s’intègre dans un effort plus large, orchestré par un décret présidentiel le mois dernier (lire Qant du 31 octobre). Il veut notamment protéger les réseaux et infrastructures critiques des États-Unis, tout en promouvant l'adoption de normes de sécurité de l'IA à l'échelle mondiale.

Aussitôt dit, aussitôt fait.

Pour en savoir plus :

L’ESSENTIEL : Alibaba, Boston Dynamics, Cardano, Circle, Google, Quezon City, UK Safer Internet Centre

ROBOTS

Le robot derrière le pinceau

L’artiste Agnieszka Pilat peint aux côtés de trois robots Spot, dans le cadre d’une collaboration dans un musée de Melbourne.

Trois chiens-robots Spot, conçus par Boston Dynamics et nommés Basia, Vanya et Bunny, ont entamé une résidence de quatre mois au National Gallery of Victoria à Melbourne, où ils créent de l'art sous la supervision d’Agnieszka Pilat. Connue pour son approche techno-optimiste et ses collaborations avec des sociétés de la Silicon Valley, l’artiste les a entraînés pour qu’ils expriment des "personnalités" artistiques distinctes à travers un mélange d'IA, de logiciels et d'apprentissage automatique.

Le robot Spot, notamment utilisé par la police de Los Angeles (lire Qant du 10 novembre), se retrouve cette fois dans un contexte où il peint des toiles, en suivant certes un langage pictural simplifié. Agnieszka Pilat, qui vit elle-même avec un de ces robots à New York, veut chercher à changer la perception publique des robots.

Pour en savoir plus : The Guardian

INTELLIGENCE ARTIFICIELLE

La Russie veut construire une troisième voie pour l’IA : Vladimir Poutine vient d'annoncer une stratégie nationale sur le développement de l'intelligence artificielle. Oubliant la forte présence chinoise sur le marché, le président russe a souligné la nécessité d’empêcher l’apparition d’un monopole occidental dans le domaine. Il a insisté sur l'utilisation de solutions russes pour créer des systèmes d'IA fiables, transparents et sécurisés pour l'humain, et il a exprimé son opposition à l'éthique et aux normes occidentales reflétées dans les systèmes d'IA actuels.

Pour en savoir plus: Reuters, Associated PressGoogle joue les chiens d’aveugle : Google vient d'annoncer la publication en open source du projet Guideline, qui vise à améliorer l'autonomie des personnes aveugles ou malvoyantes en utilisant le machine learning sur ses téléphones Pixel. Ce projet veut permettre aux utilisateurs de marcher, voire même de courir, de manière indépendante. Un téléphone fixé à la taille guide leur déplacement le long d'une ligne peinte sur un chemin piétonnier à l'aide de signaux audio et de la détection d'obstacles.

Pour en savoir plus: MarkTechPostUn chatbot face aux violences domestiques : La ville de Quezon City aux Philippines vient de lancer Sophia, un chatbot assisté par intelligence artificielle, conçu pour aider les victimes de violence domestique. Sophia permet aux utilisateurs de signaler des incidents et de sauvegarder des preuves de manière anonyme et sécurisée. Développé par l'organisation suisse à but non lucratif Spring ACT, Sophia offre un soutien dans plusieurs langues. D’après ses créateurs, il se distingue par son intelligence émotionnelle, qui lui permet d’offrir aux victimes une assistance compréhensive et respectueuse.

Pour en savoir plus: The InquirerProtéger les enfants face aux risques de l’IA : Le UK Safer Internet Centre, issu d’un partenariat entre trois organisations britanniques de protection de l'enfance, vient d'appeler à une action urgente concernant l'utilisation par les enfants de générateurs d'images par IA dans les écoles pour créer du contenu impliquant d'autres enfants. L'organisation appelle à sensibiliser les enfants aux risques associés à ces images et à améliorer les systèmes de surveillance dans les écoles, afin de prévenir les abus et le chantage.

Pour en savoir plus:The Guardian

BLOCKCHAINS

Circle prend pied au Japon : Circle, l'émetteur du stablecoin USDC, s'est associé à SBI Holdings, un géant japonais des services bancaires et financiers, pour étendre sa présence au Japon. Cette collaboration vise à faciliter la circulation du USDC dans le pays, via SBI Shinsei Bank, qui offrira des services bancaires à Circle et SBI VC Trade, qui se prépare à s'enregistrer comme service de paiement électronique au Japon.

Pour en savoir plus: BloombergUne blockchain qui offre des services IA : Cardano vient d’ouvrir Girolamo en bêta test sur Discord. Girolamo Cardano est un mathématicien italien du XVIème siècle mais, ici, Girolamo de Cardano est un chatbot IA relié à une blockchain open source et réservé aux détenteurs d’un cryptoactif, le CGI. Conçu pour fournir des réponses en temps réel et contextuellement pertinentes à un large éventail de questions des utilisateurs, y compris la génération et l'analyse d'images, Girolamo est présenté comme une alternative à GPT-4. CardanoGPT se veut “un LLM décentralisé”, qui offrira plusieurs bots spécialisés, dont Girolamo est le premier. Dès 2021, Cardano avait présenté une infirmière robotique, en collaboration avec SingularityNet et Hanson Robotics.

Pour en savoir plus: CryptoSlate

QUANTUM

Alibaba s’éloigne du quantique : Alibaba vient de fermer son laboratoire de calcul quantique au sein de sa filiale de recherche, Damo Academy. Le groupe a fait don du laboratoire et de son équipement à l'université de Zhejiang. Cette décision s'inscrit dans le cadre d'une restructuration plus large d'Alibaba en six unités, malgré l'annulation récente du projet de spin-off de sa division cloud. Le groupe veut concentrer ses efforts sur l'intelligence artificielle, dont les objets mathématiques sont assez proches du calcul quantique.

Pour en savoir plus: Reuters, Bloomberg

EXPERT

Baisser le coût du feedback humain pour entraîner les robots

Des chercheurs du MIT et de l’université de l’État du Washington proposent une méthode pour crowdsourcer la partie humaine de l’entraînement, particulièrement dispendieuse.

...