Gemini, Pinocchio, les puces et les soldats

Malgré les maladresses de sa communication, Gemini renforce les puces IA de Google • Le Royaume-Uni consulte sur l’IA et la finance • La blockchain arrive à la COP28 • Des robots redressent leur colonne vertébrale • Bienvenue dans Qant, qui examine les conséquences stratégiques de l’IA selon le général Mark Milley, ce vendredi 8 décembre.

« Le progrès est devant nous, à condition de dépasser sa propagande » Paul Virilio

Chaque jour, les journalistes de Qant illustrent les tendances de fond qui animent la tech. Ils s’appuient sur Kessel Média et utilisent l’IA générative depuis mars 2022.

L’ÉVÉNEMENT

Derrière Gemini, la puissance de frappe des TPU

La présentation de Gemini a montré que les TPU de Google avaient la capacité d’entraîner un LLM du niveau de GPT-4. Mais pas encore celui d’atteindre l’AGI, n’en déplaise aux communicants.

Le lancement en grande pompe de Gemini par Google (lire Qant du 7 décembre) a quelque peu éclipsé l'autre annonce de l'entreprise de Sundar Pichai, à savoir la sortie de son accélérateur d'IA le plus puissant à ce jour, le TPU v5p et d’un “hypercalculateur”, une nouvelle architecture de calcul à haute performance basé sur ces puces.

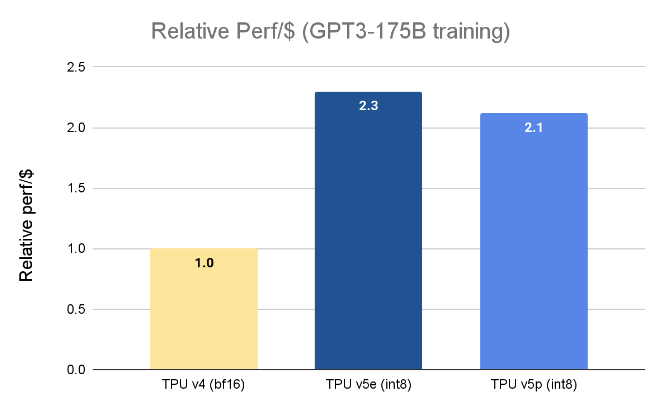

Cette mise à jour du TPU v5e, lancé au mois d’août, promet des performances encore supérieures. Google affirme que le TPU v5p peut entraîner jusqu’à 2,8 fois plus rapidement que le TPU v4 un modèle de langage de la taille de GPT-3 (175 milliards de paramètres). Mais ces performances ont un coût : chaque accélérateur TPU v5p coûte 4,20 $ de l'heure contre 1,20 $ de l'heure pour le TPU v5e. Plus lent, ce dernier reste pourtant marginalement moins cher.

Techniquement, jusqu'à 8 960 accélérateurs v5p peuvent être couplés dans un seul module, avec une interconnexion de 600 Go/s. Chacun d’entre eux offre 459 téraflops de performances bfloat16 (ou 918 téraops Int8, si l’on renonce à la virgule flottante), avec 95 gigaoctets de mémoire et une bande passante de 2,76 To/s. Mais c’est le marketing qui compte.

Un rival pour Nvidia

Alors que les GPU (Graphic Processing Units) de Nvidia sont nées pour les jeux vidéo, les TPU (Tensor Processing Units) de Google sont des circuits intégrés spécialement conçus pour accélérer les calculs liés à l'apprentissage automatique et précisément le calcul tensoriel. Google les a longtemps réservés à son usage interne et ne les commercialise, directement ou via ses services cloud, que depuis 2018. C'est sur ces TPU que Google a entraîné sa suite de modèles Gemini, dont le plus puissant atteint le niveau de GPT-4.

OpenAI, fragilisée par ses problèmes de gouvernance, a donc enfin un rival sérieux. Mais c’est aussi le cas de Nvidia, jusqu’à présent en situation de quasi-monopole pour l’entraînement des modèles, justifiant des résultats financiers stellaires (lire Qant du 7 septembre,du 14 novembre et du 23 novembre).

Devenu le premier électronicien du monde, Nvidia pâtit doublement des sanctions américaines contre l’exportation de ses puces les plus avancées en Chine. Tout d’abord, Washington s’attaque à une activité qui correspond à 20 % de son chiffre d’affaires. En outre, la Chine se mobilise pour faire de Huawei un concurrent du même niveau, avec quelques premiers succès (lire Qant du 8 novembre)

Les mensonges de Gemini Cricket

OpenAI et Nvidia peuvent compter, toutefois, sur la maladresse de Google en communication. Le lancement de Bard avait été gâché par des erreurs commises par le chatbot pendant sa présentation à la presse (lire Qant du 14 février). Pour éviter un sort semblable à Gemini, Google a choisi de présenter le nouveau modèle par une série d’entretiens et une vidéo hyperbolique. Le modèle semble y entretenir une conversation naturelle avec un être humain, avec des performances multimodales proches de l’intelligence artificielle générale.

Il n’aura pas fallu vingt-quatre heures pour qu’il émerge que la vidéo était truquée et que Gemini est très loin des performances qu’on voulait lui prêter. OpenAI a construit son succès sur une certaine réserve, en déployant ses modèles très progressivement et en communiquant sur les risques que les progrès en IA pouvaient poser. Microsoft lui a emboîté le pas avec des versions bridées, “corporate”, des mêmes modèles.

Présenter calmement un modèle du niveau de GPT-4 aurait largement suffi à vendre du temps de calcul dans le cloud, au moment où toutes les organisations, et même les forces armées, doivent se réinventer (lire Expert ci-dessous). Certaines habitudes sont difficiles à perdre. Mais tant qu’il restera dans la hype de la Silicon Valley, Google accumulera les faux pas.

Pour en savoir plus :

L’ESSENTIEL : Apple, Banque d’Angleterre, BlackRock, McDonald’s, Meta, Monetary Authority of Singapore, Quera Computing

ROBOTS

La souris qui courbait l’échine

En ajoutant une colonne vertébrale articulée à une souris robotique, des chercheurs de l’université de Munich ont nettement augmenté son agilité.

La colonne vertébrale flexible de la souris est composée de huit articulations contrôlées par des servomoteurs permettant le maintien d'une position donnée. L'équipe a soumis le robot à une série de tests, comparant ses performances avec une colonne vertébrale verrouillée et flexible. Dans le test de l'équilibre, qui consistait à lever chaque jambe à son tour, le robot avec une colonne vertébrale rigide tombait, tandis qu'avec sa colonne flexible, il parvenait à ajuster son centre de gravité et à rester debout. De plus, le robot a démontré une capacité à marcher jusqu'à 17 % plus vite et à tourner les coins jusqu'à 30 % plus rapidement lorsque sa colonne était libre de se courber.

Des souris robotiques dans les labos

Bien que des robots à colonne vertébrale rigide, comme Spot de Boston Dynamics, soient suffisamment agiles pour effectuer diverses tâches comme l'inspection de centrales nucléaires ou l'assistance policière (lire Qant du 10 novembre), l'équipe de chercheurs souligne que la souplesse supplémentaire pourrait être cruciale pour des applications spécifiques. Par exemple, dans les opérations de recherche et de sauvetage, une agilité accrue est nécessaire pour naviguer dans des espaces restreints.

Un autre domaine d'application potentiel pour ces souris robotiques est le remplacement ou le complément des souris vivantes dans certains tests scientifiques. Une institution de recherche a déjà manifesté son intérêt pour utiliser une version robotique de la souris. Cette innovation pourrait non seulement réduire le besoin d'animaux vivants dans les tests, mais également fournir des données précieuses pour améliorer les modèles de souris robotiques.

Pour en savoir plus : New Scientist

INTELLIGENCE ARTIFICIELLE

Les régulateurs financiers britanniques se méfient de l’IA : La banque d'Angleterre, dans son rapport sur la stabilité financière, avertit que le progrès rapide de l'intelligence artificielle et de l'apprentissage automatique pourrait menacer la stabilité financière du Royaume-Uni. L'institution financière prévoit d'examiner leur usage croissant dans le secteur, notamment pour la détection de fraudes. Avec la Prudential Regulation Authority, elle lancera une consultation sur ces technologies avant la fin de l’année, mettant en lumière les défis de compréhension et de régulation.

Pour en savoir plus: The GuardianMeta se met au dessin : Meta vient de lancer "Imagine with Meta", un outil de génération d'images disponible gratuitement aux États-Unis. Face aux controverses précédentes sur ses outils IA, Meta prévoit d'ajouter des filigranes invisibles aux images pour augmenter la transparence et la traçabilité, une technique déjà adoptée par d'autres entreprises comme Microsoft, Google ou encore Getty Images (lire Qant du 27 septembre).

Pour en savoir plus: Tech CrunchBlackRock démarre 2024 avec l’IA : BlackRock vient d'informer ses employés que l'entreprise prévoyait de déployer en janvier ses premiers outils d'intelligence artificielle générative pour ses clients. Les outils, intégrés dans les systèmes de gestion des risques Aladdin et eFront de BlackRock, aideront les clients à extraire des informations.

Pour en savoir plus: Financial TimesDe l’IA sur place ou à emporter : McDonald's vient d'annoncer une collaboration avec Google pour intégrer l'intelligence artificielle générative dans ses opérations à partir de 2024. Cette initiative, qui comprend des mises à jour matérielles et logicielles dans plusieurs milliers de restaurants de la marque, vise à optimiser les opérations en utilisant l'IA pour analyser de grandes quantités de données.

Pour en savoir plus: The VergeApple cadre ses modèles : Apple vient de lancer MLX, un cadre de modèles d'intelligence artificielle développé par son équipe de recherche en apprentissage automatique. MLX permet de construire des modèles fonctionnant efficacement sur Apple Silicon, les processeurs d’Apple. Ce cadre, inspiré par des frameworks comme PyTorch, se distingue par une mémoire partagée, augmentant la compatibilité avec différents appareils.

Pour en savoir plus: The Verge

BLOCKCHAINS

La blockchain pour gérer le carbone : Une équipe de chercheurs des Émirats Arabes Unis a lancé pendant la COP28 à Dubaï une nouvelle plateforme de blockchain pour le suivi et le commerce du carbone. Cette initiative, développée par le Technology Innovation Institute d'Abu Dhabi, permet le commerce international de jetons de carbone liés à des investissements dans des projets verts. La plateforme vise à enregistrer les émissions de carbone des organisations publiques et privées à travers le monde.

Pour en savoir plus: Coin TelegraphPayer en yuans numériques à Singapour : La Monetary Authority of Singapore (MAS) a annoncé un accord avec la Banque populaire de Chine permettant aux touristes chinois d'utiliser le yuan numérique, ou eCNY, lors de leurs visites à Singapour. Auparavant, la Chine avait déjà intégré le eCNY avec Hong Kong et signé un accord similaire avec la Banque centrale des Émirats Arabes Unis. Par ailleurs, plusieurs filiales de banques étrangères en Chine ont lancé des solutions eCNY (lire Qant du 30 novembre).

Pour en savoir plus: Ledger InsightsLes États-Unis veulent accélérer en blockchain : Une commission de la Chambre des représentants des États-Unis a adopté à l'unanimité un projet de loi favorable à la blockchain, le Deploying American Blockchains Act. Il prévoit de confier au secrétaire au Commerce américain la mission de promouvoir le déploiement et l'utilisation de la technologie blockchain, afin de renforcer la position des États-Unis dans ce domaine. Outre ce programme de déploiement, des comités consultatifs soutiendront l'adoption de la blockchain par les agences fédérales. Le soutien bipartisan n’augure pas, cependant, de l’aboutissement du projet, qui fait partie de plus de 50 propositions similaires au Congrès. Il doit encore être voté par la Chambre des Représentants et par le Sénat, de couleurs politiques opposées.

Pour en savoir plus: Coin Telegraph

QUANTUM

Des atomes neutres pour identifier les erreurs : L'entreprise américaine Quera Computing a réussi à effectuer des opérations résistantes aux erreurs sur plus de 40 qubits logiques. Une équipe de chercheurs de Harvard a démontré la capacité d’un système, basé sur le matériel développé par Quera, à identifier correctement les erreurs. Quera utilise des atomes neutres pour stocker les informations quantiques, offrant une stabilité accrue. Leur matériel actuel supporte jusqu'à 280 qubits basés sur des atomes, permettant des manipulations et mesures complexes tout en réduisant les erreurs.

Pour en savoir plus: Ars Technica

EXPERT

Le nouvel art de la guerre avec l’IA

Mark Milley, chef d’état-major des forces armées américaines jusqu’au mois d’octobre, a proposé un nouveau concept stratégique pour accueillir l’IA et les robots de combat. Rendue publique au moment de son départ, sa prise de position fait écho à celles de plusieurs personnalités, comme l’ancien CEO de Google Eric Schmidt et l’ancien directeur de la CIA David Petræus.

...