D'OpenAI à Kyutai, une question de gouvernance

Pendant qu'OpenAI met Sam Altman dehors par peur de l'IA générale, la France lance un laboratoire de recherche similaire par sa gouvernance, Kyutai, et fait tapis sur l'IA open source. Bienvenue dans Qant, qui examine aussi les risques spécifiques à cette démarche, ce lundi 20 novembre 2023.

« Le progrès est devant nous, à condition de dépasser sa propagande » Paul Virilio

Chaque jour, les journalistes de Qant illustrent les tendances de fond qui animent la tech. Ils s’appuient sur Kessel Média et utilisent l’IA générative depuis mars 2022.

L’ÉVÉNEMENT

Sam Altman : ça s’en va et ça revient et ça s’en va…

Sam Altman, CEO et cofondateur d’OpenAI, a été mis à pied vendredi. Greg Brockman, président de l’entreprise, et plusieurs chercheurs de haut niveau ont démissionné dans la foulée. Ils constitueront une nouvelle équipe de recherche chez Microsoft. Investisseurs, partenaires et personnel ont louvoyé tout le week-end dans une affaire de gouvernance qui prend le monde à témoin.

Sacré week-end pour OpenAI. Vendredi soir, son CEO et cofondateur, Sam Altman, a été démis de ses fonctions par le conseil d'administration de l'entreprise pour "manque de transparence". Mira Murati, directrice technique d'OpenAI, a pris la relève en tant que directrice générale par intérim et tenté une médiation pendant le week-end. En effet, Sam Altman n’est pas tombé seul. Greg Brockman, président et cofondateur d'OpenAI, ainsi que Jakub Pachocki, directeur de la recherche, et deux chercheurs de haut niveau, Aleksander Madry et Szymon Sidor, l’ont immédiatement suivi.

Vendredi soir, OpenAI était décapité. Ce lundi matin, le CEO de Microsoft Satya Nadella vient d’annoncer que Sam Altman et Greg Brockman vont prendre la tête d’une nouvelle équipe de recherche, constituée pour eux, au sein de Microsoft. Emmett Shear, cofondateur de Twitch, prendra la relève de Mira Murati à la tête d’OpenAI, marquant l’échec des négociations.

Idéalisme efficace

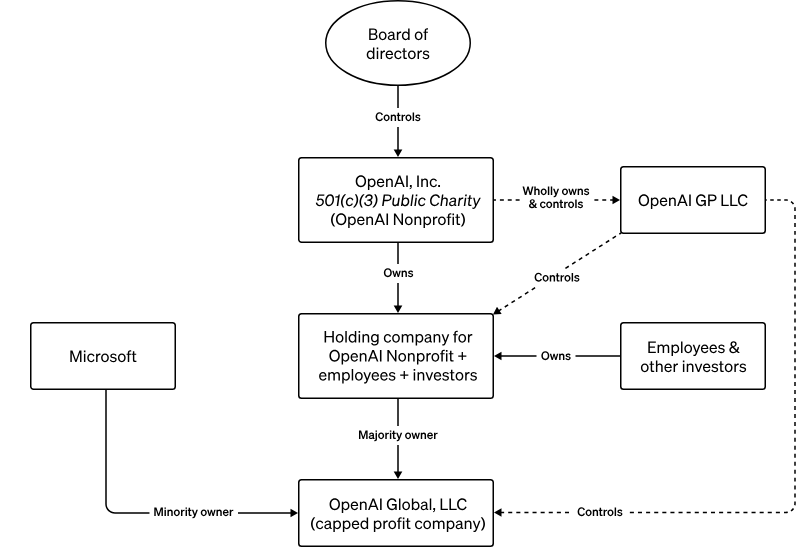

Le conseil d'administration de la fondation de recherche qui contrôle OpenAI (voir graphique ci-dessous), aurait jugé sur proposition d’Ilya Sutskever, cofondateur et directeur scientifique, que l'approche de Sam Altman était devenue incompatible avec les responsabilités et les valeurs de la fondation qui contrôle l’entreprise : développer une intelligence artificielle dans de bonnes conditions de sécurité pour l’humanité.

Père de la renaissance des réseaux neuronaux avec Geoffrey Hinton, Ilya Sutskever est aujourd’hui l’un des scientifiques les plus inquiets du développement de l’IA. Il a notamment créé cet été, au sein d’OpenAI, un groupe dédié au “superalignement”, l’alignement des modèles d’IA générale et des “superintelligences”.

Ses inquiétudes auraient trouvé une écoute favorable chez deux autres membres du conseil, Helen Toner, de l’université Georgetown, et l’entrepreneure Tasha McCauley, toutes deux liées au mouvement de “l’altruisme efficace”, tout comme Ilya Sutskever et de nombreuses autres figures de la Silicon Valley (ainsi d’Elon Musk et de Sam Bankman-Fried : lire Qant du 8 novembre).

Or, la gouvernance d’OpenAI – dont s’inspire Kyutai, la fondation de recherche lancée vendredi à Paris – place tout le pouvoir dans les mains des administrateurs de la fondation, aux dépens des actionnaires de la société commerciale.

Cette inquiétude pour la sécurité de l'IA n'est pas nouvelle chez OpenAI : en 2020, en raison de préoccupations similaires, Dario et Daniela Amodei avaient quitté l’entreprise pour créer Anthropic, avec une orientation plus forte vers la sécurité. Les inquiets, cette fois, ont pris le pouvoir.

La Matrice et le grand capital

Microsoft, qui détient 49 % du capital de la société après s’être engagée à y investir 11 milliards de dollars, n’aurait été informée du départ de Sam Altman que quelques minutes avant son officialisation. Les investisseurs extérieurs, des VCs du calibre de Sequoia, Khosla Ventures et Thrive Capital, auraient été mis devant le fait accompli. Or, ceux-ci étaient en train d’organiser une deuxième cession d’actions du personnel, sur la base d’une valeur d’entreprise de 86 milliards de dollars (lire Qant du 23 octobre). Celle-ci est évidemment remise en cause.

La médiation de Mira Murati était donc très clairement dans l’intérêt des salariés d’OpenAI. Certains ont cru initialement que Sam Altman avait souffert des retards de développement de GPT-5 (lire Qant du 19 octobre). Il semble que ce soit tout l’inverse : c’est parce qu’il voulait pousser les feux du développement de nouveaux modèles qu’il a été évincé.

Le ministre délégué au Numérique français, Jean-Noël Barrot, a lancé un appel à l’ancien CEO d’OpenAI : “Sam Altman, son équipe et leurs talents sont les bienvenus s'ils le souhaitent en France où nous accélérons pour mettre l'intelligence artificielle au service du bien commun.”

Microsoft s’est révélée plus attractive, mais on ne sait jamais.

Pour en savoir plus :

NUMÉRO SPÉCIAL : L’IA Pulse à Paris

Vendredi dernier, la communauté naissante de l’IA en France s’est réunie à Station F.

Paris fait le choix de l’IA open source contre les industries culturelles

Les allées de la conférence AI Pulse à Station F résonnaient d’appels en faveur du développement de l’open source. Avec le spectre d’un AI Act très discuté, au micro comme en dehors.

Emmanuel Macron : “Nous devons faire de l’open source une force française”

“Pour que notre voix porte, la France doit avoir les entreprises et les talents qui comptent. Nous devons nous maintenir dans le peloton de tête” : même en n’intervenant qu’à distance à Pulse AI, le Président de la République a choisi son camp, vendredi. L’ancien directeur général de Google Eric Schmidt, qui investit dans Kyutai (lire ci-dessous), avait bien tenté un tacle : "Les maths et les talents techniques en France sont de classe mondiale. Le problème, c'est que vous êtes coincés avec Bruxelles". A quoi Emmanuel Macron de répondre, en vidéo : “La régulation n’est pas l’ennemie de l’innovation. Il ne s’agit pas de définir des “bons modèles” mais de s’assurer que les services mis à disposition de nos concitoyens soient sûrs ”. Et le ministre délégué au Numérique Jean-Noël Barrot de river le clou : “Nous adoptons une approche radicalement favorable à l'innovation en matière de réglementation”.

Cette “radicalité” n’est pas du goût de tout le monde. Le même jour, 80 associations professionnelles du monde de la culture (dont les sociétés d’auteurs, l’Adami et le Snep pour la musique, le Geste pour la presse, le SNE pour le livre et ainsi de suite) faisaient paraître une lettre ouverte demandant la transparence des modèles d’IA. Et La Lettre de publier un article remarqué sur l’action de lobbying de Cédric O, administrateur de Mistral et membre du Comité de l'intelligence artificielle générative, qui conseille le gouvernement sur la réglementation.

Le temps de l’innovation

Or, la France soutient au Conseil européen une position contraire à celle de ses industries culturelles. Elle tente en effet de favoriser la naissance d’une industrie européenne, voire hexagonale, de l’intelligence artificielle. Et celle-ci réclame la main la plus légère possible. “A l’heure actuelle, nous sommes dans le temps de l’innovation plutôt que dans celui de la réglementation. La réglementation arrive aux États-Unis car ils ont beaucoup d’avance sur l’Europe” expliquait Xavier Niel, PDG d'Iliad, puissance invitante vendredi. A l’entendre, la réglementation américaine est poussée par les grandes entreprises du secteur désireuses de rendre difficile l’entrée de nouveaux acteurs sur le marché.

Xavier Niel s’est réjoui que la France puisse, grâce au lancement de Kyutai, “bénéficier de l’attraction qu’amène l’open source”. Jensen Huang, directeur général de Nvidia, a fait chorus, mettant en avant la “capacité vitale de l'open source à dynamiser la recherche et l'engagement de toutes les startups, de tous les chercheurs et de toutes les industries”.

L’IA open source à la française était représentée par le CEO de Mistral Arthur Mensch, qui compte notamment Xavier Niel parmi les investisseurs de son premier tour (lire Qant du 15 juin). A rebours des industries culturelles, le fondateur de Mistral a déploré que le texte de l’AI Act se soit éloigné de son objectif initial, “un texte sur la sécurité des produits”, pour s’attaquer aux modèles eux-mêmes: “On ne peut pas réglementer un moteur dépourvu d'usages” , martelait-il sur X-Twitter.

Réglementer les usages et non les modèles, c’est exactement la position qu’a prise le Conseil européen sur l’AI Act, sous l’impulsion française et allemande, contre le Parlement européen (lire Qant du 26 octobre et du 12 mai). Sans doute le compromis final ne sera-t-il ni du goût des industries culturelles, ni de celui d’Arthur Mensch.

Du moins ce dernier peut-il espérer que personne à Bruxelles ne s’aperçoive des risques de l’open-source (lire l’Expert ci-dessous).

Pour en savoir plus :

L’ESSENTIEL : Ampere Computing, Kyutai, LightOn, Quandela, Scaleway

Kyutai, une sphère dont le centre est à Paris

AI Pulse a été l’occasion du lancement de Kyutai (“sphère” en japonais), un laboratoire de recherche en intelligence artificielle. Il sera financé par Xavier Niel, le PDG de CMA-CGM Rodolphe Saadé et l’ancien patron de Google Eric Schmidt, pour plus de 250 millions d’euros.

Un OpenAI à la française. Sans que personne n’ose formuler l’image vendredi, alors que l’original s’apprêtait à faire hara-kiri devant le monde entier, le projet d’un laboratoire de recherche en open science, à but non lucratif, entièrement dédié aux modèles “fondationnels” évoque clairement la création, en 2015, d’OpenAI comme un centre de recherche indépendant de Google, partageant à tous ses résultats, sans but commercial.

En septembre, le groupe Iliad de Xavier Niel avait lancé l’initiative, la dotant de 100 millions d’euros (lire Qant du 27 septembre). Vendredi, Rodolphe Saadé, PDG du géant du transport maritime CMA-CGM, est venu doubler la mise. Eric Schmidt, ancien PDG de Google, apporte une somme non précisée qui place la somme totale au-dessus de 250 millions d’euros – au point qu’on l’arrondit, parfois, à 300 millions d’euros. “Nous sommes ouverts à davantage d’investisseurs. Ils sont les bienvenus, car les montants investis pour développer des solutions en IA doivent être importants pour que les résultats viennent” conclut Rodolphe Saadé.

Les fondations des modèles de fondation

L’équipe de Kyutai sera dirigée par Patrick Perez, un ancien de Microsoft Research. Le rejoignent dans la sphère des anciens de Deepmind et Meta : Édouard Grave, Hervé Jégou, Laurent Mazaré et Neil Zeghidour. Le conseil scientifique comprend le prix Turing Yann Le Cun, qui dirige les laboratoires de Meta.

Les résultats de la recherche seront accessibles librement, comme ceux d'OpenAI avant son changement de stratégie en 2019. L'idée est donc non seulement de partager gratuitement les modèles qui seront créés par les équipes de Kyutai, mais aussi les étapes qui ont mené à ces modèles. “L’un de nos premiers buts sera de créer un LLM “from scratch”, de manière à pouvoir faire de la recherche fondamentale à n’importe quel niveau du développement du modèle, du pre-training au fast tuning” explique Patrick Perez.

“Nous allons nous concentrer sur des modèles fondamentaux. Viser d’abord des avancées fondamentales en IA sur l’entraînement de modèles notamment multimodaux, d’améliorer leur perception et leur intelligence, pour ensuite appliquer nos recherches à des tâches plus précises”, complète Neil Zeghidour.

Pour en savoir plus :

Scaleway n’Ampere pas une… : Ampere Computing et Scaleway ont annoncé à Pulse un partenariat pour proposer des serveurs d’architecture ARM pour les services IA, en particulier l'inférence. Les instances ARM de Scaleway utilisent des serveurs alimentés par la famille de processeurs Altra d'Ampere, promettant de répondre aux besoins des applications IA à une fraction du coût des autres solutions, bien que les prix n'aient pas encore été rendus publics.

Pour en savoir plus: The Register…Et se lance dans le quantique as a service avec Scaleway : A l'occasion de la conférence AI Pulse, Scaleway a annoncé s'associer à Quandela pour lancer un service de Quantum as a Service (QaaS). Cette initiative comprend notamment l'offre par Scaleway d'un service QaaS alimenté par un simulateur de circuits exclusif de Quandela, accéléré par les GPU Nvidia H100 Tensor Core.

Pour en savoir plus: Le Monde InformatiqueLe deuxième Albert de LightOn pulse sans hallucinations: Représentée à AI Pulse par son CTO Iacopo Poli, qui s'est exprimé sur le rôle du Reinforcement Learning dans les grands modèles de langage, la start-up française LightOn a dévoilé Albert-40B-1023, deuxième version de son modèle open source. Cette nouvelle mouture est selon l'entreprise moins sujette aux hallucinations, et propose également une fonction "Chat with Docs" pour interagir avec des documents.

Pour en savoir plus: Le Monde Informatique

EXPERT : Elizabeth Seger, Centre for AI Governance

Les risques nouveaux de l’IA Open Source

L’open source tendait à améliorer, généralement, la sécurité des logiciels. Mais avec l’IA, tout pourrait changer, d’après des chercheurs d'Oxford, Cambridge et Harvard.

Dans l’IA, par opposition aux algorithmes traditionnels, un modèle open source peut être plus dangereux qu’un modèle fermé. Il est bien plus aisé de désactiver les limites imposées à un LLM (“jailbreak”) et d’introduire de nouvelles capacités via le “fine-tuning” si on a accès à l’intégralité du modèle, poids et jeu d’entraînement compris. Alors que l’IA fait courir de nouveaux risques à l’humanité, il faut donc trouver de nouvelles manières de préserver les finalités de l’open source sans compromettre la sécurité.

...